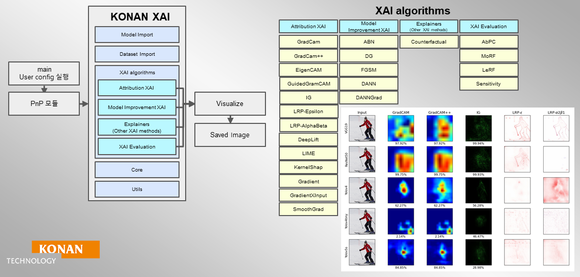

▲‘KONAN XAI’ 프레임워크 개념도 / 자료=코난테크놀로지

인공지능(AI) 소프트웨어 전문기업 코난테크놀로지(대표 김영섬)가 AI 시스템의 결과에 영향을 미치는 주요 요소를 사람이 이해할 수 있는 형태로 설명해주는 제반 기술인 설명가능 AI(XAI)를 자사의 비전(Vision) 및 대규모언어모델(LLM) 사업에 접목하며 기술 경쟁력을 높인다고 9일 밝혔다.

코난테크놀로지는 과학기술정보통신부와 정보통신기획평가원(IITP)이 추진하는 ‘플러그앤플레이 방식으로 설명가능성을 제공하는 AI 기술 개발 및 AI 시스템에 대한 설명 제공 검증’ 과제에 공동 연구기관으로 참여 중이다.

KAIST 설명가능 인공지능연구센터(센터장 최재식 교수) 총괄 하에 2022년부터 2026년까지 5년간 수행되는 이 연구는 AI 모델의 의사결정 과정 전반을 사용자에게 설명할 수 있는 기술적 기반 확보를 목표로 한다.

특히 다양한 AI 모델에 설명 기능을 손쉽게 연결할 수 있는 플러그앤플레이(PnP) 구조를 핵심 기술로 다룬다. PnP 방식은 설명가능성을 고려하지 않은 모델에도 재학습 없이 적용할 수 있어 다양한 모델 환경에서 일관되게 활용할 수 있다.

코난테크놀로지는 대학·연구소 중심의 참여기관 가운데 유일한 기업으로, 산업 적용과 사업화를 주도하고 있다. 특히 3400여 고객사를 기반으로 연구 결과가 산업 환경에 실질적으로 활용될 수 있도록 기술 이전 및 적용 전략을 추진하고 있다.

올해는 국방 분야에서 신뢰성 높은 AI 제공을 위한 XAI 원천기술 고도화와 군 도메인 맞춤형 적용 연구에 집중했다. 내년에는 사업 영역을 LLM까지 확대한다.

KAIST 총괄 하에 진행 중인 ‘대형언어모델 내부의 환각 현상 원인 규명 및 제거 기술’ 연구를 활용해 LLM의 안전성과 신뢰성 강화를 도모하고자 LLM의 내부 작동 구조를 분석하고 환각 발생 원인을 규명·제거하는 기술을 사업에 적용할 계획이다.

이 기술은 공공, 발전, 의료, 제조, 금융, 법률 등 각 도메인의 고위험 분야에서 신뢰 기반 AI 서비스를 제공하기 위한 핵심 기반 기술로 자리잡는 것이 목표다.

강동식 기자 lavita@datanews.co.kr

[ⓒ데이터저널리즘의 중심 데이터뉴스 - 무단전재 & 재배포 금지]

많이 본 뉴스